從從事風險管理相關工作的有緣人可以進來看看,應該可以有些收穫與觀點啟發

更歡迎不吝交流回饋

前言

專業期刊Safety Science在 2014年出版特輯(special issue),邀請國際專家與審稿主編為文討論有關安全此一學科的範疇、常見問題與思想誤謬(The Foundations of Safety Science),探討許多發人深省的觀念與議題;其中一個關鍵議題與大哉問是:「意外事故的發生能否被預見與預防?」

就業界實務的立場,安衛人員的存在價值當然是預防重大事故的發生、保護同仁的人身安全與健康以及讓公司工廠正常運作創造經濟價值;國際勞工組織與不少國際級企業也都宣告與在理念上認定:「所有的意外事故與工作傷害都是能夠被預防的」

然而理念與理想(應然ought to be)是一回事,實際的情況(實然practice and reality)是另一回事;如果以事故是否持續發生以及能否有效制正確地預測與預料事故的發生來驗證以上理念的正確性,則以上理念應該是被否證與否定的;換句話說,就實務與事故總是會發生的結果論而言,意外事故與工作傷害的發生尚無法被有效的預測與防止(或者說人的認知與能力有限,只能預防部分的意外事故與職業傷病)。

「意外事故的發生能否被預防?」這個看似簡單的問題,不同的觀點與觀念引導出不同的思維邏輯與管理哲學,如果沒有深入思考這個命題,逕行針對發生與遭遇的重大意外進行事故調查、檢討事故發生原因,很容易落入倒果為因、穿鑿附會與自圓其說的邏輯誤謬。針對以上大哉問,本文摘錄說明近代兩種對立的學術見解-常態事故理論(Normal Accident Theory, NAT)與高可靠度組織(High Reliability Organization, HRO),並嘗試整合不同見解提出有關看待事故發生的觀念與防災減損的統合做法。

事故不能被預防-複雜系統與禍起細微

有鑒於1979三浬島核災事故的啟發,耶魯大學社會學家Perrow在1984年出版Normal Accidents: Living with High-Risk Technologies一書認為-工廠、核電廠或太空梭的運作有如一個複雜的系統,由於系統內部有許多複雜的控制回饋機制與不同單元間環環相扣(The system is complex and tightly coupled),儘管針對可能人為失誤或設備裝置失效都有預先設想與建置各項防護措施與安全連鎖機制,意外事故的發生仍然無法避免或者始料未及(The system has catastrophic potential);換言之,重大事故的發生不是一種意外,而是一種預料之中的常態(Normal)。

傳統古典的工安事故發生與預防理論,例如骨牌理論或乳酪cheese理論,把重大事故的發生,視為多個因素或錯誤同時發生所產生的後果;因此對於預防事故發生所提出的解決對策,包含3E(engineering, education, enforcement)與保護層(layer of

protection, LOPA);而3E與LOPA本質上可謂是提高人員作業的可靠度與降低設備單元的失效率,觀念上把不同單元間或人機介面之間視為獨立:「彼此之間沒有交互作用、也不會相互影響」;因此提高個別設施裝置的可靠度與降低人為疏失的發生機率,就能夠降低整體系統的事故與災難發生機率。

Perrow的洞見在挑戰以上傳統觀念中-不同因素與因子之間「彼此獨立、不會相互影響」的前提假設,他認為:

1.額外的防呆、備援與安全連鎖機制,看似提高了系統的可靠度,但卻增加了系統的複雜度與讓系統更不可靠(防護機制需要額外的校正與測試)

2.防呆備援與自動控制機制,反而讓操作的人失去判斷力(因為受制於系統回饋的各項訊號,無力判別各種信號的真偽與實際狀況)

3.各項的防護措施與機制,反而讓組織的領導人更放心(忽視安全)追求生產效率(游走在系統安全運作極限與包絡面的邊緣,相對安全餘裕safety margin不足)

而簡單怪罪犯錯的人員失效的設備有以下的好處與心理認知偏誤

1.簡化因果邏輯、容易解釋(人腦習慣於簡單的因果詮釋)

2.可以把事故與出錯當成異常(outlier),而不要自我否定與全面檢討

3.有助於最高管理階層撇清責任(法律與accountability)與迴避全面改善的成本

NAT觀點可謂震撼與動搖原本的觀念-事故的發生與出現不是一種陰錯陽差的不幸或者作業人員疏失與設備元件失效的”異常”,可謂是一種”必然的常態”。許多學界先進開始思考,面對人員管理、組織運作、製程設備交互影響的複雜系統 (social-technical system),該如何從原先見樹不見林的怪罪犯錯的人與失效的設備原件,提升到從整個組織的宏觀層次與整個系統運作的整體脈絡,分析各種情境因子對於事故發生的貢獻。從組織管理的角度出發,浮現安全文化/氣候的理論觀點;而從系統工程的角度出發,浮現的是Safety Research 在2011年特輯(special issue)探討的主題-系統複雜性(Complexity and Safety),原本線性(1+1=2)與局部單元可靠度的思維模式,逐漸轉變為從"人機介面"與"各系統單元複雜互動"來看待安全與事故的發生-事故的發生不是一個單向與單純的前因導致後果的事件鏈,而是各種因素因子之間動態、非線性交互作用的結果(1+1≠2),安全與可靠度兩者不是同義字(Safety ≠ Reliability)。

事故可以被預防-高可靠度組織的觀點

相較於悲觀、認為事故很難被預料與預防的NAT觀點,有批學者反過來思考:「為什麼有的組織與系統極端複雜,出錯和發生事故幾乎是不可避免的(“unforgiving environments”),然而這些組織卻能夠運作良好,到底它們是怎麼辦到的?」於是這些專家學者,挑選海軍航空母艦、機場航管人員與核電廠等組織進行研究,甚至針對航空母艦的運作甚至進行了長達五年的實地觀察與人員訪談,Sutcliffe歸納洞見與心如下:

1. 事前預想各種可能出錯情境與失效模式,預先準備乃至於在設計階段就納入考量,針對各種遭遇的事件也進行試後的檢討,並且將相關討論紀錄與檢討經驗心得列入交接(Preoccupation with failure, 意思是「事先」「關注」,也就是「事先認定」災害會發生;不只是認定會發生,而且是認定會發生自己從沒料想過會發生的意外。而非心存僥倖、覺得自已不會那麼「倒楣」)

2. 真對事故原因與情勢的變化抗拒簡單的解釋,多深入追問幾個why,乃至於運作團隊成員的組成盡可能多樣化,吸納不同的見解以避免決策盲點的一言堂、鼓勵團隊成員隨時反應與討論問題(Reluctance to simplify interpretations)

3. 對於現場運作與變化相關資訊,即時進行傳遞與分享,確保現場人員具備高度的環境狀況警覺意識(situation awareness, sensitivity to operations),運作當中不挑戰系統人員與設施的極限,當遭遇意外狀況時,不同單位資源能夠相互支援

4.承諾投入資源以建構系統與組織對於各項意外事故的耐受力、恢復彈性與韌性(Commitment to resilience) 例如船艦在建造時規劃有多個防水倉間,單一區劃與倉間受損,船隻不會沉沒;針對每次事故不斷檢討、調整與改進原有的運作模式

5. 決策尊重專業與現場人員

(Deference to expertise),有不安全、危險疑慮與危機狀況發生時,最清楚狀況的第一線人員與技術專家可以無需請示高層,立刻中斷生產採取必要措施,決策依據專業而非職稱與位階(彼此清楚與尊重各自的專業)。

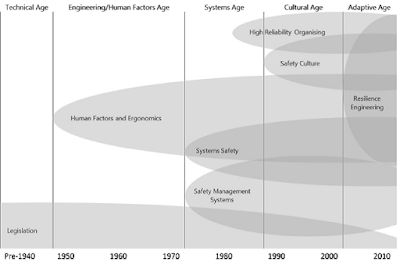

而就學術理論的演進脈絡(參見圖1),在高可靠度組織(HRO)的基礎上,又衍生出柔韌工程Resilience Engineering(RE)

|

|

圖1 各理論的演變與時代背景(出處Harvey et al)

|

相較於原本的HRO,RE吸納更多先前包含人因、組織安全文化、系統工程等理論的觀念;就理論的區別與概念的差異而言,High Reliability Organization延續原本提升可靠度(設備元件)與減少變異(人員作業)的思維,具體作法包含:教育訓練提升人的認知與能力、建立各種SOP與checklist、查核與確認的機制;運作上不強調挑戰組織與硬體設備運作的極限與效率,盡量保守在設計安全規範內運作。而RE在概念上,轉而強調不是減小變異,而是加大組織與系統的容錯與承擔變異的能耐:例如工程上的保護層(layer of protection), 備份與備援(redundancy and backup);運作上預先發想各種極端情境,以擬定應變計畫(Contingency Plan)與營運持續計劃(Business Continuity Plan)、進行各項準備與替代方案,進而擴大組織運作的彈性與包絡範圍,以因應內外部環境的不斷變動進行調適(adaptation)。

對立理論觀點的整合

理論的目的在於找出各種背後的規則規律、解釋現象的發生機制,乃至於便透過各種手法或政策制定,控制或改變這些現象;而科學的進步與典範轉移在於透過實驗與實證不斷修正或推翻錯誤的推論及假設,因此除了瞭解理論的洞見與應用方式,更要了解理論的限制與缺陷。Hopkins對於以上兩大理論的主要批判為:理論的構念(construct)都不夠清晰,難以進行實證或否證,例如:

以NAT而言,如何衡量系統的complexity與tightly coupled?如何判定事故的發生是難以避免(inevitable)的常態(Normal)?

再就HRO而言,所謂的”留心(mindfulness)”與”調適柔韌(Resilience)”,也很難去衡量及認定

兩個理論使用需許多無法直接衡量的抽象概念與沒有統一定義的專有名詞(同樣的問題也存在於安全文化、安全氣候理論),來描述與詮釋事故之所以發生或者沒發生的現象,也各自夠舉出一些例子來說明與支持各自的觀點,也都沒有辦法進行對照實驗或實地比較判別高下;因此NAT與HRO或RE只能稱為是學術假說、信念與理念,而非可被驗證科學定理(theorem)與定律(law)。

整合看待兩種理論的觀點與方式彙整如下:

微觀或宏觀

NAT

- 看發生事故的結果論與發生事故的1%不到的特例與異常狀態

- 從總體宏觀與機率的角度而言,人會犯錯、設備機台會故障,加上禍起細微的莫非定律詛咒,因此事故的發生可謂是合理的預期,而非意料之外。

HRO

- 看到的是組織正常運作的過程與大部分時間99%以上的穩定狀態

- 組織如何抗拒出錯的過程與手法,乃至於組織如何不斷從每次事故教訓當中,不斷學習與成長進步

從微觀究責(Micro and Accountability Viewpoint)的角度看,每件事故的發生,一定可以找出造成此一事故發生主力近因(Proximate

Cause)與改善的權責單位(Risk

Owner and Sponsor),可能是作業人員的疏失、某關鍵元件的失效或者是人機介面與訊息的誤判等。然而從宏觀或然率的角度看((Macro and Probability Viewpoint)),人員的疏失或元件的失效,可謂只是時間早晚與機率的問題,而非權責與因果關聯(犯錯的人與失效的元件,並非是意圖釀成事故才故意犯錯與失效)。有趣與弔詭的地方在於,那些被HRO奉為高可靠度、安全水準的標竿組織,之所以能夠發展出各項實務作法與準則,正是在歷次災難的教訓當中,不斷反省、改善與修正觀念心態,可謂是久病成良醫。

兼顧微觀當責與宏觀機率的角度看待事故的發生,有助於跳脫頭痛醫頭的陷阱與見樹不見林的盲點。

已知或未知

Faber將意外事故與風險的發生歸納如圖2,風險的組成與事故的原因,包含以下幾部分

1.現有知識不能理解(超出人類已知知識的範疇),例如居禮夫人研究放射性物質鐳,而當時人類對於游離輻射危害性的認知與知識不足

2.當事人無法理解(個人知識與經驗不足),例如承包商聽從業者指示進行溫泉池清理,清潔作業人員不知道溫泉當中可能存在有害氣體硫化氫與硫化氫的危害。

3.當事人知道風險與危害的存在,但是選擇忽略或是承擔,例如經過數次重大火災延燒事故教訓經驗,一般科技業建廠會避免使用可燃性塑膠作為風管;然而部分業者建廠,考量製程原物料特性、成本與施工便利性,仍然選擇使用PP塑膠風管(知道有此一風險,但覺得不會發生在自己公司)。

4.當事人知道風險與危害的存在,也選擇採取因應措施,然而這些措施錯誤、不完備或足夠。例如日本福島核電廠,建廠設計時已知有地震與海嘯的風險,構建了5.7米 高的海堤,卻遭遇15公尺大海嘯;雖然有12組柴油發電機(以預防單一發電機故障失效)提供緊急狀況使用,卻未預料到這些發電機因海嘯衝過海堤、海水淹沒而同時失效。

|

| 圖2 風險的範疇與圖譜 (出處 Faber) |

相較國內事故原因調查常用的直接原因、間接原因與基本原因(直接原因(Director

Causes)係指造成事故的能量、危險物或有害物。間接原因(Indirect Causes) 係指不安全狀態或不安全行為。基本原因(Basic Causes)係指潛在管理系統的缺陷與缺失。)的分析架構,Faber將風險與事故的發生區分為:已知或未知?是忽略還是選擇承擔?如果風險不能接受,各項的防範是否正確或足夠?這個分類架構背後所隱含的邏輯與涵義是:人(主事者與當事人)的認知與能力有限,某些狀況與情境的發生超出人的想像與當初設計範疇,不能無限上綱的追究所謂應為能為而不為的業務過失責任。

例如福島核災事件發生之後,Buongiorno等九位麻省理工學院核子科學與工程系的學者專家針對此一事故的檢討報告,即認定此一事故的發生乃是導因於不可預見的天災,福島核電廠的設計與運作並無重大缺陷;而且如果要求全世界核電廠都提高海堤高度以預防日本東北311大地震等級的海嘯,可謂是過度投資與浪費-所有的工程設計都有其規範與適用條件,當情境發展與使用狀況超越先前的設計規範時,沒有安全可言。

Faber的風險範疇與圖譜,提供一個分析邏輯與架構,一則讓大家思考所謂的管理不當與疏失,到底是人為疏失亦或是無能為力的無知;二則是提醒相關從業人員要謙卑:各種工具與手法評估出來的風險只是所有可能性與全部風險的一部分,還有一部分是未知、被忽略或囿於資源有限/暫時無能為力的部分。

組織運作的取捨與演變

Paries(2011)以US Airways Flight 1549班機迫降於哈德迅河的案例,提出作業安全防護範疇(Operational safety domains)中有三個主要的範疇:

Paries(2011)以US Airways Flight 1549班機迫降於哈德迅河的案例,提出作業安全防護範疇(Operational safety domains)中有三個主要的範疇:

1.Normal operation

正常運作,一切都在預期範圍之內。例如溫度即使偏高,也沒有超過警戒值;機件有刺耳的大聲音,但是沒有故障。不需要啟動任何應變行動。

2. Abnormal operation

在此範疇中,即使事件狀況顯示顯著偏離常態,但是尚在預期或可承受範圍。例如某些機台的溫度超過正常值、某些機件或設備故障。這些事件需要特定的行動矯正或處理。但因為經常發生或有過去的經驗,所以已經有既定的程序,由特定的人員處置。可能還不會造成嚴重後果或災害,甚至於都有可能有「緊急應變計畫」可以處置。

3. Emergent operation

狀態和正常不同、偏離常軌,甚至無從判斷到底出了什麼事情。例如有些監測的數據(例如溫度或氣體濃度、壓力,不僅超過正常值,甚至於高到不可思異)或者多個監測警報同時發報聲響大作、某些重要機件或設備故障,導致作業中斷。既有的知識和程序,甚至於緊急應變計畫中料想的情境,都無法適用於處理此一情況,而狀況看來已經瀕臨發聲災害的狀態,但是人員無法判斷狀態,也沒有頭緒可以應變。

愈是複雜的系統,有較多的連鎖互動機制與「黑箱」,無法簡單判斷是什麼原因造成系統信號的異常與造成這樣的狀況。簡單的系統,狀態和反應是線性的,容易判斷,容易處理。然從另外一個角度來說,任何組織或成員都具備一定的適應能力(Adaptability)以便因應變化。以公司或工廠為例,無論產業環境、製程、制度、成本的因素導致產能或效率的要求改變,員工都會設法因應,致力於在既定的條件與預算限制下,達到個人或單位的最高效率與績效目標;然而在適應的過程中,愈是高度的適應,愈會高度分化專注局部,忽視及喪失關注整體大環境變化的注意力,逐漸失去因應的彈性。

例如:因應不同法規的要求,事業單位的緊急應變計畫必須滿足自衛消防編組、毒災應變計畫等官方機構審查的要求,許多應該要依據現場製程危害特性與事故情境的演練類別或規模,經過這樣的依法行政過程與多一事不如少一事的「調適」,逐漸被忽略與省略。而平時的保養維護工作中,偵測器的校正、連鎖遮斷系統的測試,囿於經費或歲修工期緊湊而疏於注意;以上狀況雖然不至讓災害立即發生,然而當危害性氣體洩漏的狀況(incident)發生時,本來應該被偵測器發現洩漏狀況,進而自動連鎖安全遮斷的機制,卻因為偵測器沒有校正或連鎖機制沒有測試而導致事故(accident)發生。這樣不該是意外的意外,反而成了意外;因為「不符合預期」。

以上案例的涵義在於:

在高度適應(成本、時間、人情壓力)的情況下,組織會放棄「不常用的彈性與不需要的餘裕」。這樣的現象稱之為過度最佳化(Overadaption),雖然可更有效率的運作卻失去應變所需要的彈性與餘裕,Paries(2006)稱為過度的秩序造成的危機:過度追求效率與最佳化的過程,降低了組織因應變化與異常的韌性。

在高度適應(成本、時間、人情壓力)的情況下,組織會放棄「不常用的彈性與不需要的餘裕」。這樣的現象稱之為過度最佳化(Overadaption),雖然可更有效率的運作卻失去應變所需要的彈性與餘裕,Paries(2006)稱為過度的秩序造成的危機:過度追求效率與最佳化的過程,降低了組織因應變化與異常的韌性。

如何預防想像不到與始料未及的事故?

依據Faber架構的啟發,可以將風險區分成幾個區塊(圖3)

中心最小的區塊是經由良好的危害辨識與風險評估找到的既有已知的風險=>可以預防與進行管理;

向外擴散出去的則是從內部與外部事故經驗當中發現到:知識經驗不足、運作還不夠落實、還可以做得更好的部份=>可以從失敗與事故當中學習與累積經驗

最外圍的部份則是難以想像、未知與未曾發生遭遇的風險情境,一但發生即被認定為是所謂黑天鵝(請參見Taleb黑天鵝效應 The Black Swan一書與https://en.wikipedia.org/wiki/Black_swan_theory)

經常發生的製程偏離、異常失效或威脅,通常已經有一套程序可以因應,也就是對應於Normal operation的狀態。不常遇到的威脅,組織即使沒有既定的程序可以排除或因應,但是透過啟動緊急應變計畫可以處置。例如阿波羅13號事件,機率很低,但知道發生爆炸與洩氣,因此可以按照程序和經驗處理。US Airways Flight 1549班機兩個引擎都失去動力,雖不知道是兩個引擎都因為鳥擊造成熄火,也有程序可以依循,但成敗的關鍵是駕駛員當下即時的判斷(以哈德遜河成功迫降事件來看,成功應變的關鍵不是機組人員受過兩個引擎失效必須在河上迫降的訓練,而是Sully機長個人的人格特質、能耐和他駕駛滑翔機的嗜好和經驗。)。最後的是從來沒有想過或有人曾經發生過的事件,(亦即文中提到的黑天鵝事件),連當下發生了什麼事都弄不清楚,例如911事件,當下也不知道雙子星大樓是被飛機撞擊;應變人員不知道該以什麼「事件」來因應,爆炸?火災?地震?該不該疏散?該怎麼救援?完全沒有概念。

黑天鵝事件可怕之處,不在於個別的應變程序是否存在或熟悉,而是根本不知道面對的是什麼?要啟動什麼程序?遑論需要什麼資源或支援。黑天鵝具有以下特質與特性:

- 想像不到、出乎意料;不知道發生機率(Uncertainty)

- 發生在當事人知識疆界以外(=未知或認知的盲點):我們不知道的比我們知道的更多與更具威脅性

- 發生機率越低、次數越少的風險,越難累積知識與經驗;越常發生的,越能夠累積如何因應的知識與經驗、加以有效管理

面對黑天鵝事件的風險管理觀念與策略提議如下

將未知轉為已知-風險評估方法論與觀念的修正

依據台灣職業安全衛生管理系統(TOSHMS),危害辨識與風險評估的流程如圖4。實務操作上,危害辨識與風險評估可謂是基於當事人經驗的一種猜測,而且由於人的認知能力有限,組織的經費與資源也有限,因此找出的風險情境可謂只是局部與部分。

而需要被特別關注與思考的有以下幾點。

首先就事故的能見度與發生經驗而言,能夠被鑑別出來的事故與危害類型通常為發生機率高/嚴重度相對低的人員工作傷害事故,至於嚴重度高/發生機率低的火災爆炸或者七級以上地震引發火災或建築物倒塌等情境,對於危害辨識與風險評估人員而言,由於事故的情境發展難以想像、外加此類型事故的預防往往涉及不同權責部門與利害關係人,囿於權責與經費往往只能”選擇”忽略此種事故情境。

再就風險鑑別的方法論而言,通常評估某個危害或事故的風險大小係考量(=想像)其發生機率與發生後的嚴重度,透過類似圖5的3*3或5*5矩陣來判斷風險的大小是否可接受;此一方法的誤謬在於把嚴重度與可能性兩者視為彼此無關聯的獨立因素加以評估。

就實際狀況而言,同類型的事故,例如火災或地震,通常嚴重度越高的情境,其發生機率越低(圖5):嚴重度與可能性兩個因子間彼此並非獨立,而是存在關聯性;而想像更糟的情境有助組織看出自身目前的侷限、盲點與做出更好的準備。

風險特性曲線涵義說明如下:

- 就事故情境而言,發生機率Likely>Probable> Possible;嚴重度Likely<Probable< Possible;例如就化學品倉庫的事故情境而言,洩漏是可能的(Likely)事故情境,可燃性有機溶劑洩漏之後,又遭遇火源被引燃是Probable的情境,而有機溶劑洩漏+被引燃+火勢隨風管延燒可謂是Possible的情境

- 風險的能見度與發生機率有關,對於一般經驗有限的危害辨識與風險評估人員,其所想像的事故情境通常是個人親身經歷或廠內曾經發生過的Likely情境,而非Probable與 Possible的情境(=低估風險)

- 就事業單位的風險管理而言,發生機率高但嚴重度低的Likely情境,某種程度其實不需要關切與擔憂(嚴重度低,而且常常發生,代表組織可以承受後果與損失),真正需要被考慮的反而是發生機率低但嚴重度高的Probable與Possible情境(因為一但發生,後果嚴重,公司可能會倒閉結束營業)

風險的評估需要超越嚴重度與發生機率等級的猜測,逐步將各種事故的發生情境更加具體地描繪成形,乃至於隨著經驗與知識的累積,能更針對發生機率與能見度更低但嚴重度更高的風險情境(或許有人會認為這是「捕風捉影」與「危言聳聽」;從某種程度上也確實可做此批判,然而有足夠的知識和經驗當作背景,這樣的推論不是「捕風捉影」,而是「知微杜漸」。)進行管理,有效地將未知的風險變成已知的部分,可行方法有:

- 從自己與他人的事故經驗當中學習,建立事故資料庫進行量性分析或針對重大事故進行質性的深入案例研討

- 針對未知與不確定的部份進行實驗、演練、測試與驗證,以確認作業人員的認知與能力、各設備單元與系統的可靠度與可用性

- 分析比較不同系統配置與作業方式的優劣、使用經驗與曾經遭遇的事故類型,當遭遇不同極端情境時,不同配配與作業型態所可能發生的後果與脆弱環節在

- 從教育訓練的角度來看,現場負責應變的人員(平時作業的同一批人)需要的應變訓練不是一再重複的技能訓練(例如滅火、止漏、急救),而是不同的複雜情境下、甚至於資訊不足狀況不明情境下的模擬演練。由具有經驗的教官引導受訓人員進行思考與判斷,由這樣的訓練中才能強化韌性與人員因應未知狀況的認知與能力

針對組織的風險評估(或安全防護檢視),可採用歸納法(Deduction)、演繹法(Induction)兩種方法 (Ericcson, 2005)。歸納法比較可以量化,透過嚴密的檢查檢視,有多少證據、說多少話,依此歸納組織面對的風險來源和大小。通常是由上而下以及由外而內的方式執行。

演繹法通常是由下而上與由內而外來做,透過現場實際的經驗的訪查,從現有的狀況與遭遇過的事件(incident),「推論」「預測」可能發生的意外(Accident)和規模,利用觀察到的細節,來進行情境分析,思考可能發生的風險情境。對於無法預期的「黑天鵝」意外,可利用演繹法或基於演繹法的情境評估法,來擴大已知的範疇與縮小未知;也需要回頭檢視比對評估 (由上而下與由下而上) 二者之間的缺口。

以上風險評估方法論與觀念的修正,可以幫助組織建立自身風險知識地圖、了解自身的知識疆界與運作安全餘裕;透過學習或情境推演提高經驗與擴大對於意外事件的認知或了解範疇,讓一些本來覺得不可能的事件與情境發生時,不會是「黑天鵝」。對於組織系統(social-technical system)的能耐與限制有清晰的認識之後,才能因應不同任務需求與不同類型風險採取用不同理論與因應對策。

面對未知的策略與觀念-HRO/RE的啟發與限制

RE與HRO都可以增加組織運作上的可靠度與彈性及提升萬一遭遇事故時候的耐受韌性Resilience;HRO的觀念是提升運作可靠度、盡量保守,失誤與事故的發生有如超出容許規格的變異與品質不良,為提升考可靠度與降低變異,要有各項的管控程序、人員訓練與SOP,運作上也盡量不要採用未經時間驗證的各項作法與設備,不去挑戰運作極限、在原有的安全餘裕內操作。

而RE的觀念是更進一步的防呆與調適因應,設計規劃階段就思考將各種人為失誤與設備失效納入考量,以增加redundancy and barrier、達到失效失誤也安全(fail-safe);乃至在運作上也尊重現場,將第一線人員視為應變的主體,給予充分訓練、賦能與授權(empowerment),以因應作業情境的快速變化及隨時監控(continuous monitor)了解風險與安全餘裕的變動。

Pettersen & Schulman將resilience又再區分為事前的預料與準備(Precursor),

例如規劃設計要加大與預留安全餘裕(margin)及使用年限、不求最大、最快或成本最低,而是追求應變彈性與調適能耐;遭遇事故時的恢復力(Restoration),例如授權賦能、打破例行運作階層與資訊傳遞模式關鍵系統的備份與備援(redundant);與事後的調適與適應(Recovery),如公司高層關鍵主管有沒有代理人(其實是接班人)、不同的生產基地能否相互支援?與供應商保持長期合作共生伙伴關係等。

就實務管理而言,減小變異/加大可靠度亦或是增加容錯能耐與安全餘裕,兩種作法方式都需要投入資源;這兩種作法某種程度上可謂是不同的安全策略抉擇,必須做出一些取捨、無法兼顧,例如提高可靠度近似於標準化與嚴格管控,相對的對於第一線人員而言,可謂失去隨機應變的彈性與授權;而對於資源有限的組織而言,投資提升容錯彈性與增加安全餘裕的各項備用設備與以防萬一的各項設施,從追求生產效率極致的角度而言,可謂是缺乏效率與閒置資產的浪費。

如前所述,組織資源有限、人的認知與能力也有限,風險往往等同未知與未曾經經歷過的情境,所以難以有效管理。然而從累積經驗與實證的角度來看,事故的發生卻是最真實的一面鏡子,映照出種種事前不切實際的猜測、不佳的設計規劃、空口白話的保證、人員認知能力的不足與各項應該被測試確認但卻偷工減料的設施。

就組織的存活(觀念請見 Taleb反脆弱Anti-fragile一書)與同仁對於風險的警覺意識而言,經常遭遇一些(程度沒有嚴重到讓公司倒閉)事故遠比取得外部獎項或者零災害累積工時數創新高更具有建設性:獲得外部獎項與零災害工時數創新高,傳遞給同仁的訊息反而是-我們現在狀況良好、不需要重視安全與風險;過去的成功,尤其是連續多少小時沒有發生工安意外的記錄與安全第一的口號標語對於意外的防範和意外發生後的有效應變沒有有任何幫助。過去的安全記錄,只是強化自我安全管理的手段而非目的;把沒有發生意外的功勞全部歸功於既有的政策、管理方式、安全程序的成功,其實是一種忽略「運氣」的認知偏誤(Survival Bias,沒有出事只運氣好,而非是管理作上軌道;過去沒發生事故不代表未來不會發生事故);更令人擔憂的是:愈強調既有的成功和連續的優良記錄,會讓員工有無形的龐大壓力,為了保持組織目前的完美記錄和印象,造成隱匿意外或虛驚事件的默契,對於組織安全與風險管理危害更甚。

而以上的心態與組織氛圍正是塑造事故發生的溫床與脈絡,組織的經費資源有限,但要達成的目標眾多與野心宏大,沒有出事,資源與注意力由安全轉向績效(higher performance, lower safety margin);越關注績效與成本,對於安全的重視越低,直到遭遇事故與意外,回頭重視安全,形成一種動態的均衡與週期循環,圖6描繪的正是被譽為HRO典範的美國航太總署NASA在安全與績效間的反覆週期循環:發生重大事故之後,對於安全的重視大概只有持續十多個月。

風險的評估存在以下瓶頸,認知理解這些障礙有助於從業人員與組織更健全地面對風險與規劃風險管理業務:

就評估風險的方法(Methodology)而言:

- 極端事件發生機率難以估計、事態的演變難以想像(沒有可靠的評估工具)

- 各種工具與手法,讓人看見某部份,卻也忽視掉另一些部份

- 不同類型的風險難以放在一起比較大小與優先(後果嚴重度單位不同無法比較,例如火災的風險VS人員長期暴露在化學品下的健康危害風險)

就對於風險的認識與理解(Epistemology)而言:

- 人類腦神經先天存在障礙,無法客觀衡量風險:對於嚴重度(事故戲劇性情結)比較有感,而對機率大小無感

- 不同的人對於相同風險有著不同的認知與詮釋(立場框架或偏好不同

- 就商業運作而言,風險與獲利機會是一體的兩面,無法分割也不應該分割

就風險的本體與本質型態(Ontology)而言:

- 不能用過去預測未來(組織與環境的本質不斷在改變)

- 組織的資源有限,而狀況演變的可能性卻是無窮

- 莫非定律與熱力學第二定律=>人會犯錯、設備機台會故障其實是組織系統趨於低能度/高亂度下的一種自然現象與趨勢

結論與建議

關於風險管理與事故的預防,同業先進有個非常寫實的心智模式與心態描述:公司工廠與企業商業運作有如賽車,一方面要勇於冒險,追求最大、最快、效率最高與成本最低才能贏得冠軍,另一方面卻又不希望車毀人亡=發生事故、員工罹災、工廠停工,業務主管被法辦。就以上情境脈絡而言,事故的發生是一種或然率與兩難取捨下的必然結果,Dekker認為正是那些塑造出績效的組織架構、流程與指標衡量的方式導致事故發生(No organization is exempt from drifting into failure. The reason is

that routes to failure trace through the structures, processes and tasks that

are necessary to make an organization successful. Failure does not come from

the occasional, abnormal dysfunction or breakdown of these structures,

processes and tasks, but is an inevitable by-product of their normal

functioning.)

事故的發生只是組織日常運作與績效的副產物,看似有效適應(adapt to)與兼顧生產壓力、環境變化和安全要求的系統或組織,實際上卻埋藏著深沈的不利於災害防範與應變的條件(Latent condition or pathogens, Reason, 1990);追究事故發生的主力近因,例如關鍵的人員失誤與元件失效,可謂是獵巫與治標不治本;Deming談品質系統管理的觀念不是PDCA而是PDSA-不單只是用各種工具與表單去找出失誤失效原因與預防錯誤再發,更是一種學習與領悟: 學習關於複雜系統當中的各項因子的互動模式、人員心態與組織潛規則等知識(profound knowledge),不是去查核Check不符合標準的各項缺失,而是去學習Study造成這些缺失與意外事故發生的脈絡。商業產品的起步與人的學習成長往往是見招拆招、摸著石頭過河,從沒有辦法想辦法當中累積經驗;一些智慧與經驗結晶的SOP、所謂的最佳化與Best Practice往往要事後一段時間才有辦法歸納出準則與從各說各話當中判別出高下優劣。面對無窮盡的情境變化可能性,坦然接受出錯的必然可能、從失敗與事故教訓當中不斷學習,可謂是業界人員必須具備的認知觀念與修煉。

就有效學習而言,一是從自家的錯誤與遭遇的事故當中學習,由於身歷其境感受深刻,學系效果深度佳,但廣度不足;二則是從他人與友廠的事故當中學習,雖然無需付出慘痛代價與來源廣泛,但往往資訊揭露的只有事故的表象(Who/When/What/Where),沒有深入分析事故成因的深層脈絡(How/Why),建議可以採用個案研討方式進行討論與思辨,以補強分析與學習效果的深度。

就風險的評估與擴大已知範疇的角度而言,我們通常只能關注到組織平常沒遭遇風險前的正常運作情形(99%的時間與情境),難以想像出現嚴重偏離與極端事件的異常狀況(不到1%的時間與情境,某石化業前輩曾說:不到1%的缺失(事故),抹殺工安人員99%的努力。成功將飛機迫降在哈德遜河的Sully機長說:在過去42年,我駕駛過無數次班機,而我的功過卻由其中一次飛行(意外)決定。同業或許可以省思與比較兩者感觸的差異。);因此在風險評估的觀念上,運用平常的經驗去猜測可能遭遇情境的嚴重度與發生機率再套用到風險矩陣的作法可謂是偏誤與低估風險。相對較適宜的評估觀點,是用各種極端情境(可借鏡友廠事故)套用到組織目前的運作狀況,看看在此極端情境下,目前組織的整體運作在哪些環節的強度與配套機制不到位,換言之能評估標的是脆弱性,而不是所謂的風險(評估耐受強度比預測風險情境容易)

此一作法與觀念不同於利用風險矩陣法把各項風險進行排序已制定輕重緩急優先順序,而在於那些很罕見、情境的演變超乎意料之外、超過門檻的事件才會對組織造成真正危害衝擊(相對罕見,所以統計預測不準確;換言之,著重於嚴重度),參與人員必須具備想像力與判斷力,用更糟的情境來描繪出組織能夠承受的極限與彈性範疇、找出尚待確認與加強的未知環節,逐年與漸次投資提高各主要系統的反脆弱性,做更好的準備以提升組織面對未知與無常的可靠度與對抗事故的韌性。

就商業運作而言,風險與報酬是一體的兩面,任何事都有其機會成本(取捨要看損失或獲利背後的總機會成本&累積損益),事故的發生機率與潛勢是組織生產作業的一部份,讓組織柔韌有彈性(能夠承受損失、隨機應變)、而非堅固(≒僵固、只能應付特定情境)、能夠承受比別人(特別是競爭對手)更大的風險(震動變異幅度),就能從風險當中獲得創造競爭優勢的機會。

參考文獻:

Buongiorno

J. et al., Technical Lessons Learned from the Fukushima-Daichii Accident and

Possible Corrective Actions for the Nuclear Industry https://mitnse.files.wordpress.com/2011/08/fukushima-lessons-learned-mit-nsp-025_rev1.pdf

Dekker,

S., 2011. Drift Into Failure. Ashgate, Farnham, London

Ericcson, C. A., 2005, Hazard Analysis

Techniques for System Safety, Wiley, 499 p.

Faber

H.M., Risk and Safety in Engineering. http://www.staff.dtu.dk/mihf/Teaching/RiskandSafetyinEngineering

Hopkin

A., Issues in safety science. Safety Science 67, (2014), 6–14

Harvey, E.J., et al. Applying

HRO and resilience engineering to construction: Barriers and opportunities.

Safety Sci. (2016), http://dx.doi.org/10.1016/j.ssci.2016.08.019

Kathleen

M. S., High reliability organizations (HROs) Best Practice & Research

Clinical Anaesthesiology 25 (2011) 133–144

Nancy G. L., (2012)Engineering a Safer World, MIT Press http://sunnyday.mit.edu/safer-world/index.html

Paries, J., 2006, Complexity, Emergence, Resilience….,

in Resilience Engineering – Concepts and

Precepts, Ed. Hollnagel, E., Woods, D., and Leveson, N., ASHGATE, 397 p

Paries, J., 2011, Lessons from the Hudson

Perrow,

C. (1999). Normal accidents; Living with high risk technologies. Princeton Princeton University

Reason, J., 1990, Human Error, Cambridge University

Sutcliffe

K. M., High reliability organizations (HROs) Best Practice & Research

Clinical Anaesthesiology 25 (2011) 133–144

Taleb

N.N.,(2007)黑天鵝效應 The

Black Swan

Taleb

N.N.,(2013)反脆弱Anti-fragile

沒有留言:

張貼留言